LiteLLM

本教程介绍如何使用 Sophnet API Key 配置 LiteLLM,实现统一管理多种大语言模型 API 调用。

目录

1. 环境准备

1.1 硬件推荐配置

| 配置项 | 最低要求 | 推荐配置 |

|---|---|---|

| CPU | 4核 | 8核及以上 |

| 内存 | 8GB | 16GB及以上 |

| 存储 | 50GB SSD | 100GB SSD |

| 网络 | 100Mbps | 1Gbps |

1.2 软件依赖

| 组件 | 版本要求 | 作用 |

|---|---|---|

| Docker | 20.10+ | 容器化部署 |

| Docker Compose | 2.0+ | 多容器编排 |

| Python | 3.8+ | 运行 litellm 核心服务 |

1.3 获取 Sophnet API Key

步骤1. 访问 Sophnet 平台 并登录账户 步骤2. 点击用户中心,进入个人用户空间或者团队空间

在个人用户空间,添加新的API Key或复制已有API Key

在团队空间,需要进入项目详情页,左侧点击API key, 复制即可

步骤3. 保存生成的 API Key

步骤3. 保存生成的 API Key

2. 快速部署

2.1 源码获取

通过官方仓库获取最新稳定版本:

git clone https://gitcode.com/GitHub_Trending/li/litellm

cd litellm2.2 使用 Docker Compose 部署

创建 docker-compose.yml 文件: 注意:POSTGRES_PASSWORD配置后需要与DATABASE_URL=postgresql://litellm:DB_PASSWORD@db:5432/litellm中的DB_PASSWORD一致

version: '3.8'

services:

litellm:

image: ghcr.io/berriai/litellm:main-stable

ports:

- "4000:4000"

environment:

- DATABASE_URL=postgresql://litellm:litellm123@db:5432/litellm

- STORE_MODEL_IN_DB=True

depends_on:

- db

healthcheck:

test: ["CMD-SHELL", "wget --no-verbose --tries=1 http://localhost:4000/health/liveliness || exit 1"]

interval: 30s

timeout: 10s

retries: 3

db:

image: postgres:14

environment:

- POSTGRES_USER=litellm

- POSTGRES_PASSWORD=litellm123

- POSTGRES_DB=litellm

volumes:

- postgres_data:/var/lib/postgresql/data

ports:

- "5432:5432"

volumes:

postgres_data:2.3 创建环境变量文件

创建 .env 文件:

# 数据库配置

POSTGRES_USER=llmproxy

POSTGRES_PASSWORD=your-db-password

POSTGRES_DB=litellm

# LiteLLM 安全密钥

LITELLM_MASTER_KEY=sk-your-master-key

LITELLM_SALT_KEY=your-salt-key-for-encryption2.4 启动服务

# 构建并启动服务

docker-compose up -d

# 查看服务状态

docker-compose ps

# 查看日志

docker-compose logs -f litellm服务启动后:

- API 网关地址:

http://localhost:4000 - 管理界面:

http://localhost:4000/ui

3. Sophnet 模型配置

3.1 Sophnet API 端点说明

Sophnet 提供兼容 Anthropic 格式的 API 端点:

https://www.sophnet.com/api/open-apis/anthropic/3.2 配置过程

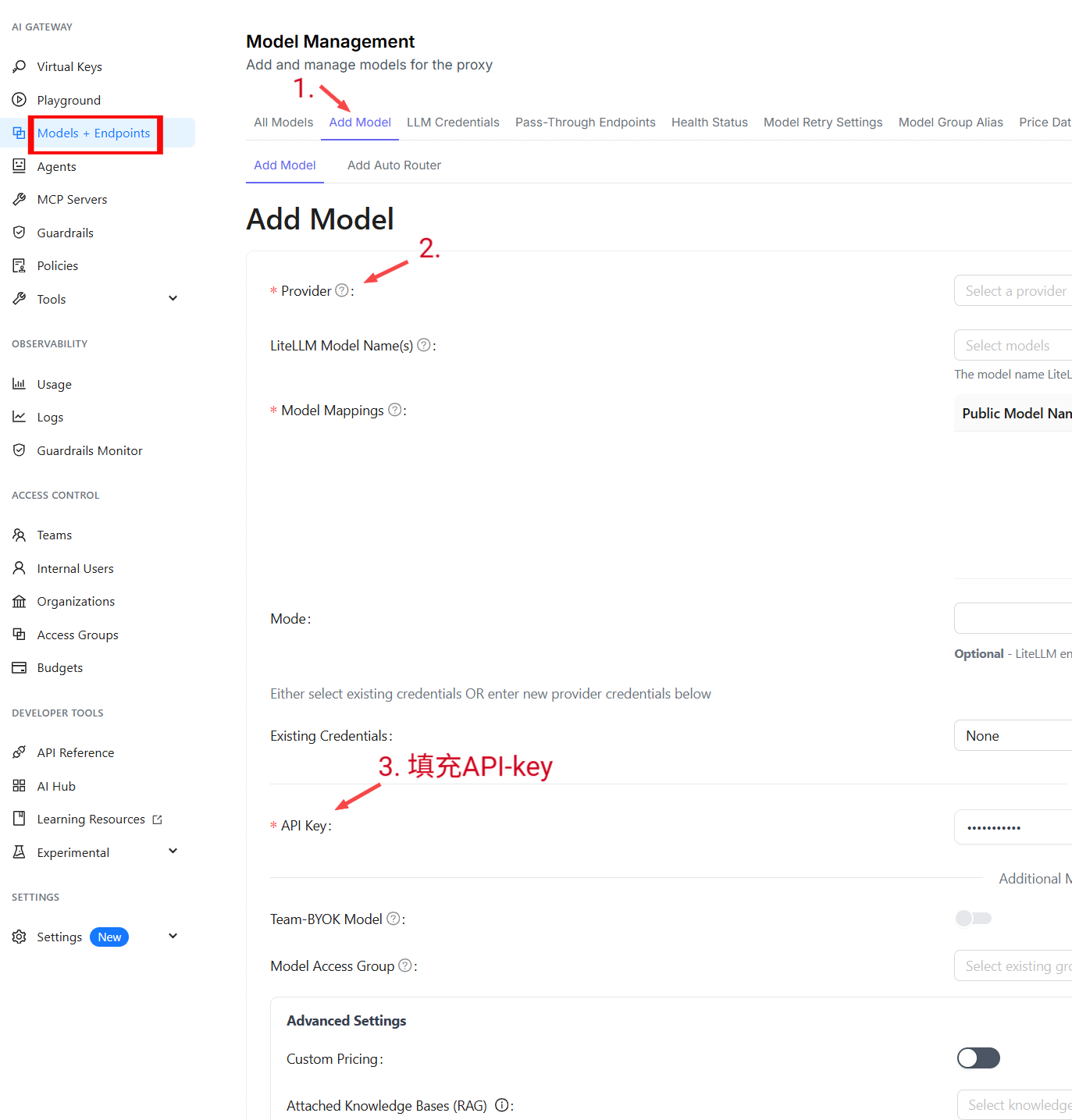

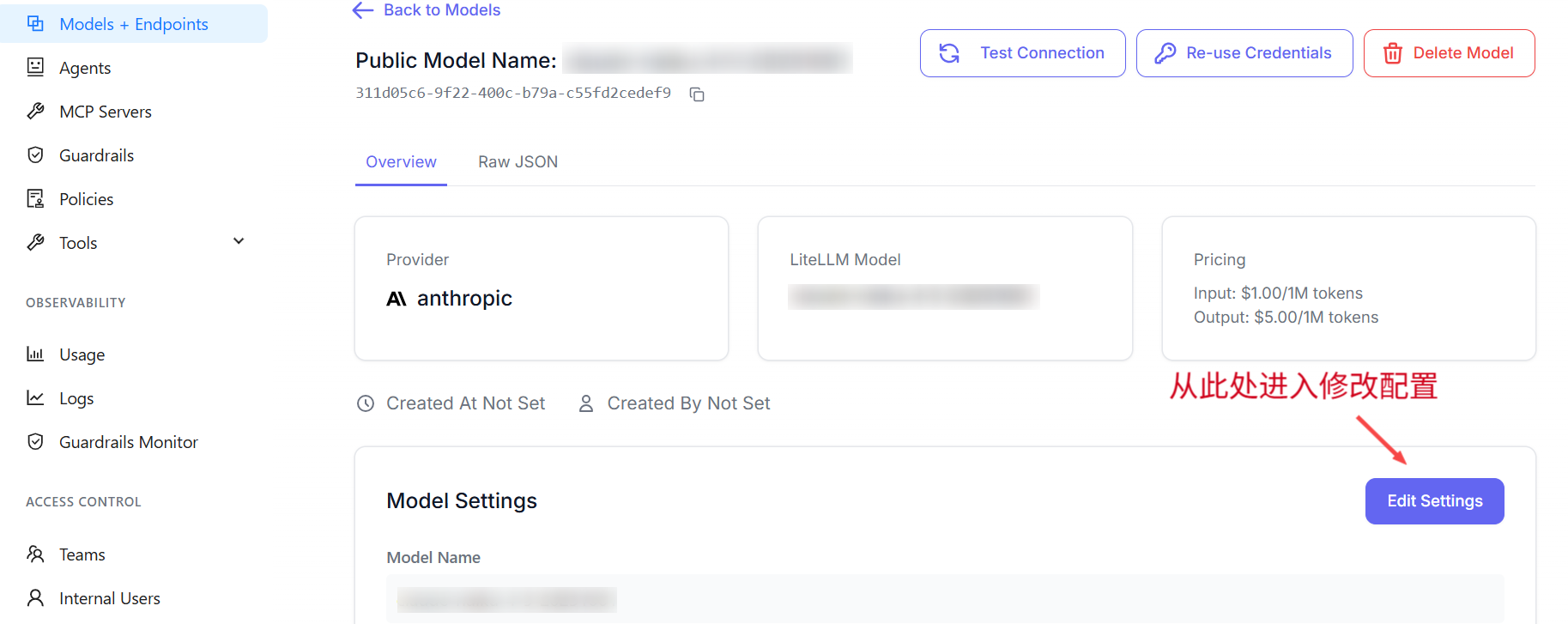

进入UI管理台-Add model, provider 选 anthropic

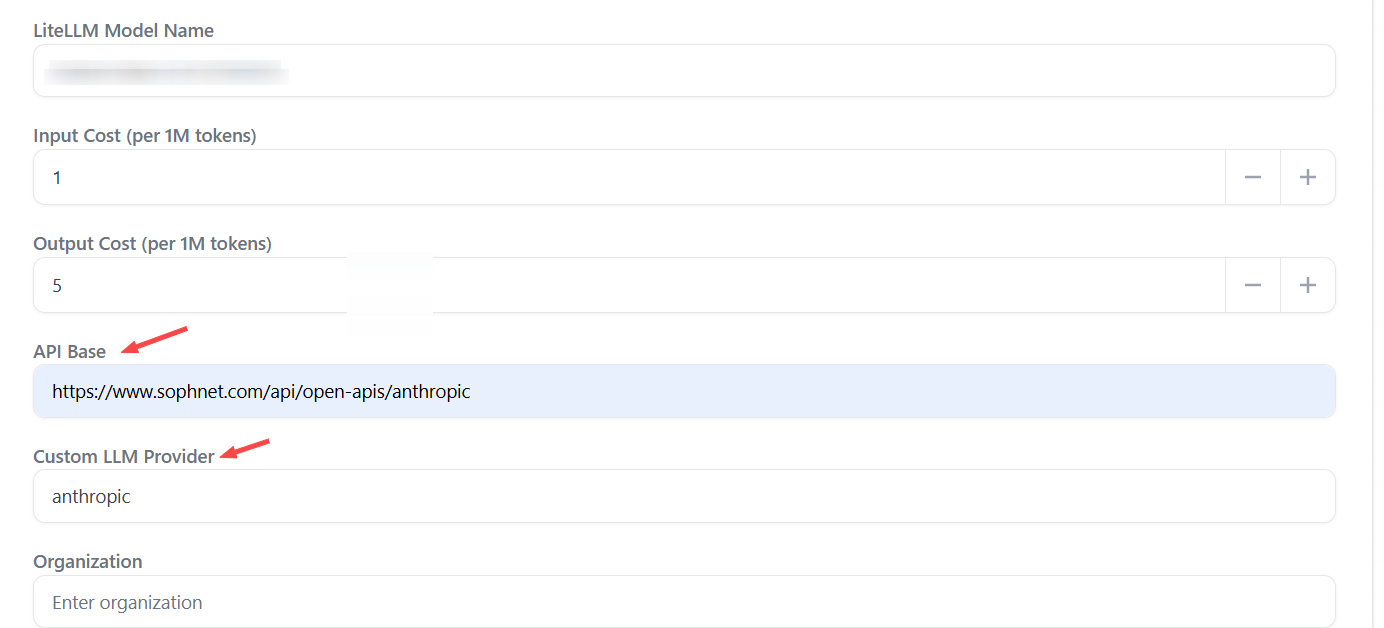

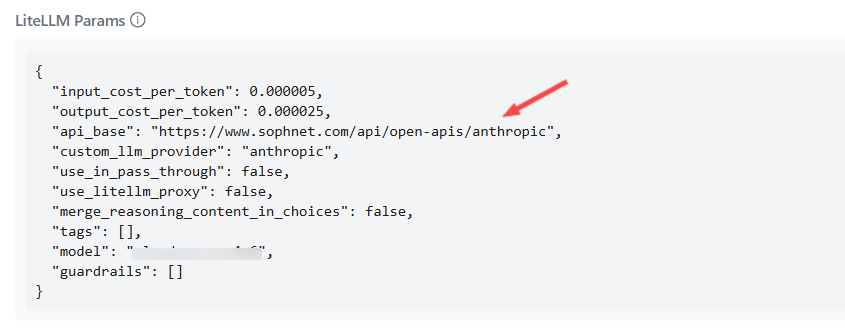

3.3 重要配置说明

⚠️ 把 API base 填到 litellm params

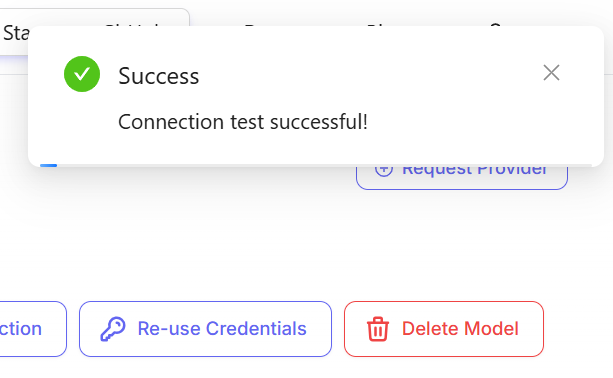

配置完成点击test_connection会显示成功连接

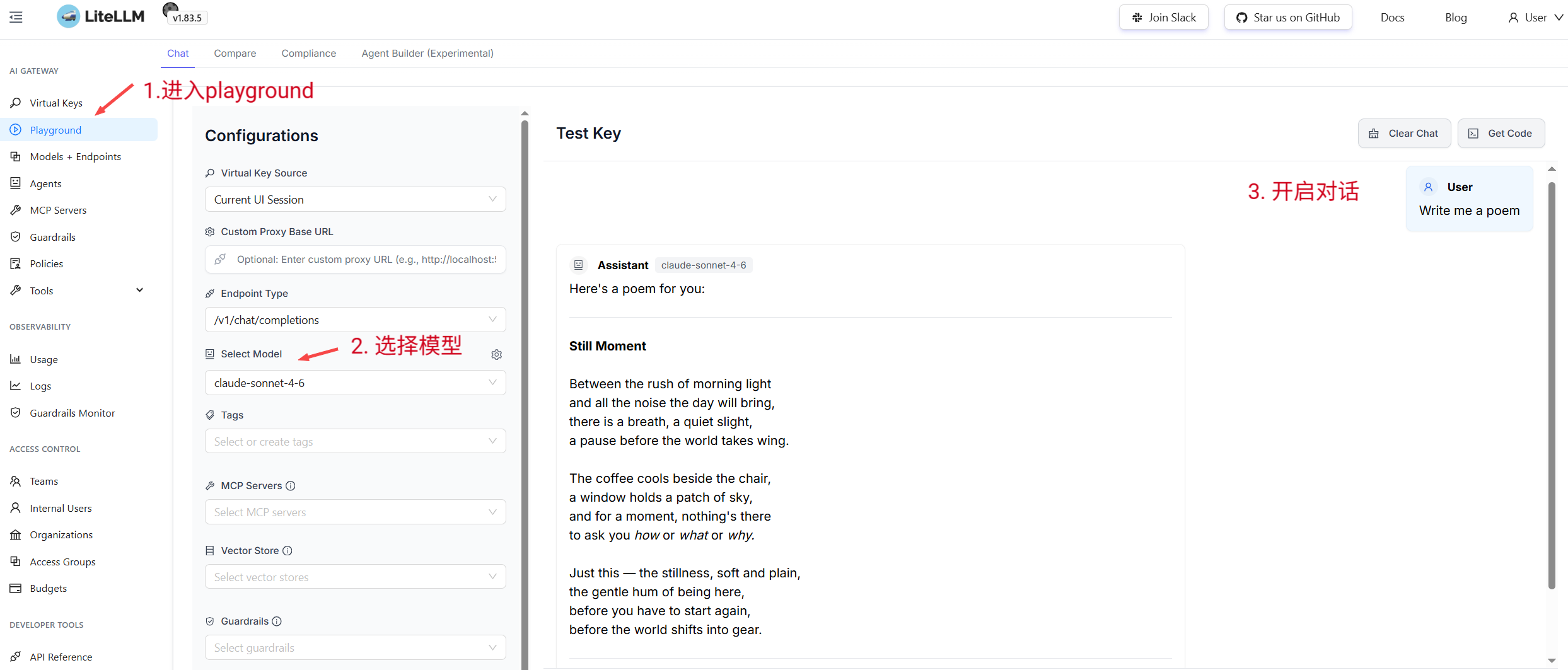

3.4 选择模型开启对话

4. 高级配置

访问控制与 API Key 管理

创建受限的 API Key:

curl -X POST http://localhost:4000/key/generate \

-H "Authorization: Bearer ${LITELLM_MASTER_KEY}" \

-H "Content-Type: application/json" \

-d '{

"models": ["model-name1", "model-name2"],

"max_budget": 100.00,

"duration": "30d",

"metadata": {

"team": "engineering",

"user": "john.doe"

}

}'5. 验证与测试

5.1 测试 API 连接

使用 curl 测试:

curl -X POST http://localhost:4000/v1/chat/completions \

-H "Authorization: Bearer YOUR_LITELLM_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "model-name",

"messages": [{"role": "user", "content": "Hello, how are you?"}],

"max_tokens": 100

}'测试多模态能力(图片理解):

curl -X POST http://localhost:4000/v1/chat/completions \

-H "Authorization: Bearer YOUR_LITELLM_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "model-name",

"messages": [

{

"role": "user",

"content": [

{"type": "text", "text": "What is in this image?"},

{"type": "image_url", "image_url": {"url": "https://example.com/image.png"}}

]

}

],

"max_tokens": 500

}'5.2 检查服务健康状态

# 健康检查

curl http://localhost:4000/health/liveliness

# 查看模型列表

curl http://localhost:4000/models \

-H "Authorization: Bearer ${LITELLM_MASTER_KEY}"

# 查看使用统计

curl http://localhost:4000/global/spend \

-H "Authorization: Bearer ${LITELLM_MASTER_KEY}"6. 常见问题

Q1: 连接测试返回 422 Unprocessable Content

原因: api_base 路径配置错误

解决方案:

确保 api_base 不包含 /v1/messages 路径:

# ❌ 错误

api_base: https://www.sophnet.com/api/open-apis/anthropic/v1/messages

# ✅ 正确

api_base: https://www.sophnet.com/api/open-apis/anthropicQ2: 如何查看详细错误日志

启动 LiteLLM 时添加 --detailed_debug 参数:

litellm --config config.yaml --detailed_debug或在 Docker Compose 中:

command: ["--config", "/app/config.yaml", "--detailed_debug"]总结

通过本教程,你可以:

- ✅ 使用 Sophnet API Key 配置 LiteLLM

- ✅ 绕过 LiteLLM 的 api_base 限制

- ✅ 实现多模型统一管理

- ✅ 设置访问控制与监控